- Cet évènement est passé.

Journée de l’axe Image sur le « Deep Learning » (08/04/2022)

08 avril 2022 9h30

Annonce :

Le développement des technologies de l’apprentissage profond en image est un domaine en pleine effervescence. Plusieurs aspects peuvent être considérés.

L’objectif principal de cette journée est d’établir un état des lieux des travaux menés en Normandie. Les contributions attendues peuvent aussi bien traiter les aspects théoriques que les aspects applicatifs de ce domaine.

Cet évènement NormaSTIC aura lieu en distanciel par visio conférence.

Appel à contributions

Les personnes souhaitant présenter leurs travaux (20 minutes) sont priées d’envoyer un titre et un résumé d’une page maximum (format pdf) avant le 16 mars 2022 aux organisatrices :

Amal Mahboubi

Caroline Petitjean

Nous vous attendons nombreux.

Apprentissage profond en image

Programme

- 09h30-09h40 Accueil

- 09h40-10h00 Thibault Durand, GREYC :

Réseaux de Neurones Multi-Echelle pour le traitement d’images stylisé

Durand_thibault_beamer_normasticRésumé :

Les algorithmes pour le traitement d’images (Super-Résolution, Inpainting, Débruitage, etc) ont beaucoup progressé ces dernières années. L’utilisation de réseaux convolutifs profonds fournit actuellement les résultats les plus impressionnants. Cependant, très peu de ces techniques sont utilisées en pratique dans des logiciels d’infographie, du fait de pré-requis techniques importants (taille des réseaux en mémoire, calculs nécessitant des GPUs), mais aussi parce que l’utilisateur n’a que tr`es peu de contrôle sur le résultat généré. Pour pallier ces problèmes, nous proposons une approche de super-résolution en deux temps, baptisée Super-Résolution stylisée, qui repose sur une architecture multi-échelle composée de branches convolutives parallèles et indépendantes pour la génération d’images. Notre contribution est ainsi double, avec la description : i. d’un réseau léger inspiré des méthodes de filtrage classiques de traitement d’images, facilement utilisable sur des systèmes sans GPU et à capacité mémoire limitée ; ii. d’un réseau polyvalent et personnalisable, autorisant un contrôle fin de la stylisation du rendu.

10h00-10h10 Débat avec l’orateur

-

- 10h10-10h30 Antoine Mauri, LITIS :

Réseau Convolutif léger dédié à la Détection Temps-réel d’Objets 3D pour la Smart Mobilité Multimodale Routière et Ferroviaire.

- 10h10-10h30 Antoine Mauri, LITIS :

Résumé :

Nous présenterons 2 approches pour la détection d’objets en 3D (une approche en 2 étages et l’autre en 1 étage). Nos 2 méthodes ont été entrainées et validées à la fois sur le dataset routier KITTI mais aussi sur notre propre dataset routier/ferroviaire acquis en exploitant un jeu vidéo. Enfin nous présenterons nos travaux en cours pour acquérir une base de données d’images réelle routière/ferroviaire.

10h30-10h40 Débat avec l’orateur

- Pause 10h40-10h50

- 10h50-11h10 Atif Anwer , LITIS :

SHMGAN – Specular Highlight Mitigation GAN using Multi-Input Polarimetric Images

Cette présentation n’a pas eu lieu.

Résumé :

Specular highlights in images pose a significant challenge in algorithms for image segmentation, object detection and other image-based decision making systems. However, most systems ignore this particular scenario and neglect input images with specular highlights instead of mitigating it in the pre-processing stage.

The proposed network is trained and tested on self-acquired and publicly available datasets of real-world images. SHMGAN is able to accurately identify the specularity affected pixels and generates high visual quality images with mitigated specular reflections. The generated images are realistic and have very low noise, distortions and aberrations as compared to the existing state of the art methods for specular highlight removal.

11h10-11h20 Débat avec l’orateur

- 11h20-11h40 Guillaume Jeanneret Sanmiguel, GREYC :

Models de Diffusion pour des Examples Contrafactuelles

Diffusion Models for Counterfactual Explanations presentationRésumé :

Les exemples contrefactuels ont démontré des résultats encourageants en tant que méthodologie pour expliquer a posteriori des classificateurs (on parle alors de méthode post-hoc). Dans ce papier, nous proposons DiME, une méthode pour générer des images contrefactuelles utilisant les récents modèles de diffusion. Utilisant le processus dit de diffusion guidée, notre méthodologie montre comment utiliser les gradients du classificateur à l’étude et ce pour la génération des explications contrefactuelles. En outre, nous analysons les évaluations de détection de facteurs de confusion et, afin d’améliorer ces évaluations, nous proposons une nouvelle métrique : la Différence de Corrélation. Notre validation expérimentale indique que DiME dépasse l’état de l’art vis à vis de 5 sur 6 métriques classiques pour le dataset CelebA.

Cette présentation sera en anglais

11h40-11h50 Débat avec l’orateur

- 11h50-12h10 Thomas Dargent, LITIS :

Orthogonalité et diversité dans les filtres de ConvNet pour la segmentation

presentationNormastic-ThomasDargent

Résumé :

On commencera par un bref état de l’art de l’utilisation de contraintes d’orthogonalité en deep learning, et l’intérêt de telles contraintes. On expliquera ensuite les mesures de similarités inter filtres. On présentera des résultats obtenus en segmentation d’images médicales et on présentera également des perspectives sur les attaques adversariales et l’explicabilité des réseaux deep.

12h10-12h20 Débat avec l’orateur

- 12h20-12h30 Proposition de collaborations, discussion, vie de l’axe (échange pour le montage de nouveaux projets, groupe de travail, appel à projets NormaSTIC,…)

- 12h30 Clôture.

Lieu

Visio conférence : le lien sera : https://webconference.unicaen.fr/b/ama-x18-qpx-d89

Compte Rendu

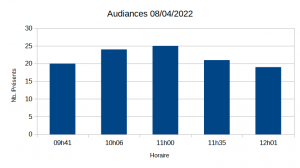

La demi journée d’étude « Apprentissage profond » était structurée en une session. Les différentes interventions ont permis d’établir un état des lieux des travaux menés au LITIS et au GREYC. Les mesures d’audiences sont présentées dans la figure suivante :